RTX3090에서 DeepSeek V3 구동하기

aAMD Ryzen 9 5950X + RTX 3090 (24GB) + RAM 128GB에서 DeepSeek-V3 실행 가능 여부

✅ AMD Ryzen 9 5950X + RTX 3090 (24GB) + 128GB RAM 환경에서는 DeepSeek-V3의 양자화 버전 실행이 가능합니다.

✅ 다만, llama.cpp를 최적화하여 빌드하고, 적절한 양자화 모델을 선택해야 최상의 성능을 얻을 수 있습니다.

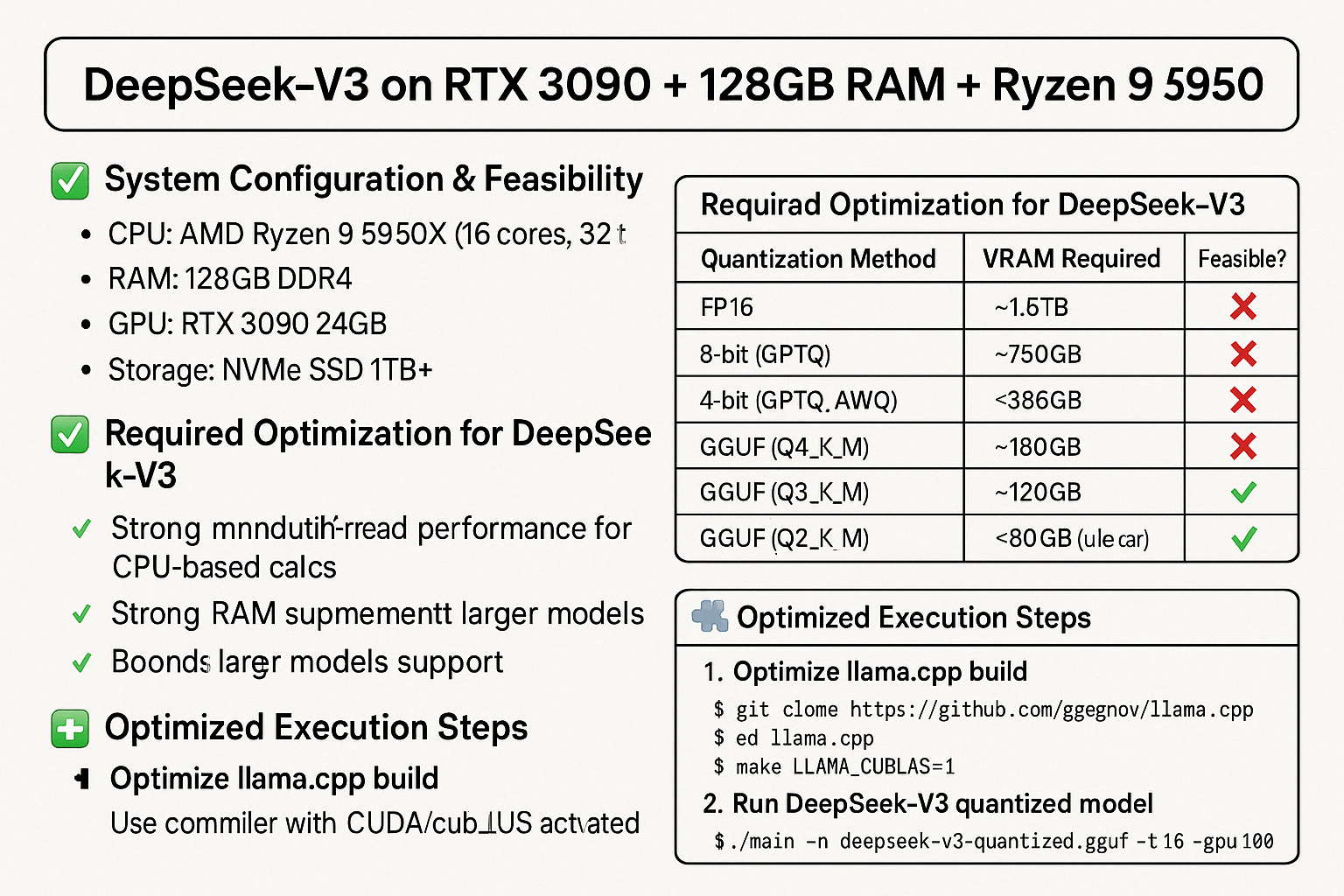

1. 시스템 구성 및 실행 가능성

사용할 하드웨어:

• CPU: AMD Ryzen 9 5950X (16코어 32스레드, 최대 4.9GHz)

• RAM: 128GB DDR4 (3200MHz 이상 권장)

• GPU: RTX 3090 24GB

• 저장장치: NVMe SSD 1TB 이상 (Samsung 980 Pro 권장)

✔ Ryzen 9 5950X는 다중 스레드 성능이 뛰어나므로 CPU 기반 연산에도 유리함.

✔ 128GB RAM 덕분에 VRAM 부족을 보완하여 더 큰 모델을 실행 가능.

✔ RTX 3090이 단일 24GB VRAM을 제공하므로 DeepSeek-V3 실행이 가장 유리한 GPU 중 하나.

2. DeepSeek-V3 실행을 위한 필수 최적화

DeepSeek-V3 모델은 기본적으로 큰 VRAM이 필요하므로, 양자화(Quantization) 를 반드시 적용해야 합니다.

(1) 양자화별 VRAM 요구량

| 양자화 방식 | VRAM 필요량 | 실행 가능 여부 (RTX 3090 24GB) |

|---|---|---|

| FP16 (기본 상태) | ~1.5TB | ❌ 불가능 |

| 8-bit (GPTQ) | ~750GB | ❌ 불가능 |

| 4-bit (GPTQ, AWQ) | ~386GB | ❌ 불가능 |

| GGUF (Q4_K_M) | ~180GB | ❌ 불가능 (RAM이 많아도 GPU에 로드 불가) |

| GGUF (Q3_K_M) | ~120GB | ⭕ 가능성 있음 (RAM 활용 필수) |

| GGUF (Q2_K_M) | ~80GB 이하 | ✅ 가능 (RAM 128GB 활용 시 안정적) |

💡 결론: Q3 또는 Q2_K_M 양자화 모델을 사용하면 RTX 3090에서도 실행 가능할 가능성이 높음!

3. 최적화된 실행 방법

(1) llama.cpp 최적화 빌드

DeepSeek-V3 모델이 llama.cpp 기반이라면 GPU 가속을 최적화해야 함

최적화 빌드 방법 (CUDA/cuBLAS 활성화)

git clone https://github.com/ggerganov/llama.cpp

cd llama.cpp

make LLAMA_CUBLAS=1✔ 이렇게 하면 CUDA/cuBLAS를 활용한 최적화가 적용됨.

(2) DeepSeek-V3 실행 방법

1. Q2 또는 Q3_K_M 양자화 모델 다운로드

wget https://huggingface.co/deepseek-ai/DeepSeek-V3/resolve/main/deepseek-v3-quantized.gguf2. 최적화된 llama.cpp 실행

./main -m deepseek-v3-quantized.gguf -t 16 --gpu 100(여기서 -t 16은 16개의 CPU 스레드 사용, –gpu 100은 GPU 연산을 100% 활용)

(3) 추가 최적화 (옵션)

• RAM 활용 강제 활성화

export LLAMA_USE_RAM=1• CUDA 연산 최적화 (cuBLAS)

export LLAMA_CUBLAS=14. 결론: RTX 3090 (24GB) + RAM 128GB + Ryzen 9 5950X로 DeepSeek-V3 실행 가능!

✔ Q2 또는 Q3_K_M 양자화 모델을 선택하면 RTX 3090에서도 실행 가능!

✔ RAM 128GB 덕분에 VRAM 부족을 보완할 수 있음.

✔ llama.cpp를 최적화 빌드하면 GPU 활용도를 높일 수 있음.

✔ Ryzen 9 5950X는 16코어 32스레드로 충분한 CPU 성능을 제공하여 실행 속도 향상 가능.

📌 최적의 실행 환경을 위해서는:

• 빠른 NVMe SSD (최소 1TB) 필요

• llama.cpp 소스 코드에서 직접 빌드하여 CUDA/cuBLAS 최적화 적용

• Q2 또는 Q3_K_M 양자화 모델 사용 필수

🚀 결론: RTX 3090 + RAM 128GB + Ryzen 9 5950X로 DeepSeek-V3 실행 가능! 다만 속도를 위해 최적화 필수! 🚀